Mostrar resumen Ocultar resumen

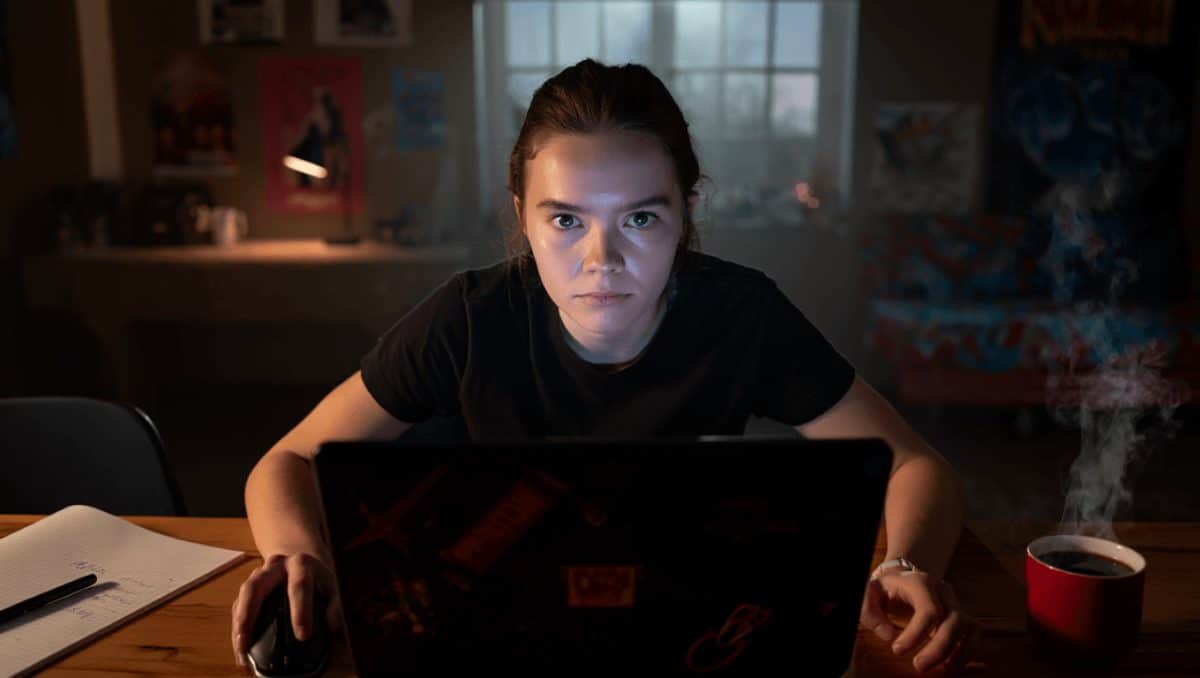

Google ha activado en varios países de Latinoamérica una herramienta para acelerar la retirada de imágenes íntimas compartidas sin consentimiento. La novedad pretende reducir la viralidad de ese tipo de contenido y ofrecer un control más directo sobre los resultados del buscador.

Qué cambia y por qué importa hoy

La nueva función simplifica el trámite para denunciar fotografías o videos privados, permite agrupar varias piezas en una sola solicitud y añade filtros automáticos para impedir que material similar vuelva a aparecer en búsquedas posteriores. Para personas afectadas, esto implica menos pasos administrativos y una respuesta más rápida por parte del buscador, aunque no sustituye acciones contra el sitio que aloja el contenido.

Corsair Frame 4500X redefine la estética del PC con cristal curvo: vista panorámica inmersiva

Google agiliza retirada en segundos de fotos íntimas compartidas sin consentimiento

Cómo funciona el proceso de eliminación

Desde cualquier resultado en Google Search se podrá iniciar el reporte usando el menú contextual del enlace. El flujo está pensado para guiar a la víctima paso a paso: identificación del enlace, inclusión de varios archivos en una misma petición y la opción de activar protecciones adicionales que limiten la aparición de contenido explícito relacionado.

Pasos básicos para reportar:

- Localizar el resultado que muestra la imagen o video y abrir el menú de opciones junto al enlace.

- Seleccionar la opción para reportar contenido personal o íntimo.

- Añadir más enlaces o archivos en la misma solicitud para evitar formularios por cada imagen.

- Activar las salvaguardas automáticas para bloquear resultados similares en búsquedas futuras.

- Consultar el estado del trámite en la sección Resultados sobre ti.

| Antes | Ahora |

|---|---|

| Denuncias individuales por cada enlace. | Posibilidad de agrupar varias imágenes en una sola solicitud. |

| Seguimiento disperso y por correo. | Panel centralizado en Resultados sobre ti para ver el estado de todas las peticiones. |

| Remoción puntual de enlaces sin medidas automáticas preventivas. | Activación de bloqueos automáticos para reducir reaparición de contenido similar. |

Es importante subrayar las limitaciones: la retirada de enlaces en el buscador reduce la visibilidad, pero no elimina el archivo del servidor que lo aloja. Para eliminar la fuente original suele ser necesario contactar al propietario del sitio o recurrir a vías legales. Google, además, ofrece enlaces a organizaciones que brindan apoyo psicológico y asesoría jurídica vinculada al proceso.

Medidas adicionales: IA y marcas de origen

En paralelo a la mejora del proceso de denuncias, Google reafirma controles sobre la generación de contenido con inteligencia artificial. Sus políticas prohíben la creación de imágenes íntimas sin consentimiento y otros materiales restringidos.

Asimismo, las imágenes producidas por su modelo Gemini incorporan marcas digitales invisibles mediante la tecnología SynthID, diseñada para identificar contenido generado por IA sin alterar su apariencia. Esta identificación busca facilitar la rastreabilidad y la gestión de abusos en plataformas que utilicen modelos generativos.

Iniciativa para contenido infantil en YouTube

De forma separada, Google destinó un millón de dólares al estudio Animaj Studio, que usa inteligencia artificial para producir animación destinada a niños. La inversión, canalizada a través del fondo AI Futures, incluye además acceso previo a modelos como Veo, Gemini e Imagen y colaboración técnica de equipos como DeepMind.

La decisión responde a una preocupación creciente: la proliferación de videos de baja calidad generados por IA en plataformas de streaming, que pueden saturar los resultados y poner en riesgo la calidad del contenido infantil. Animaj, que alcanzó miles de millones de visualizaciones en el último año, aparece como un proyecto piloto para demostrar usos responsables y escalables de la IA en entretenimiento familiar.

Para padres, creadores y responsables de plataformas, estas iniciativas implican tanto oportunidades como retos: mejores herramientas para controlar la exposición de menores y víctimas de abuso, pero también la necesidad de supervisión y marcos éticos que regulen el uso de modelos generativos.

En conjunto, las mejoras en el buscador y la apuesta por contenidos infantiles con IA muestran que Google busca combinar respuestas técnicas —filtros, marcadores digitales y paneles de gestión— con apoyo institucional y colaboraciones para mitigar daños. Para quien sufre la difusión no consentida de material privado, la novedad representa un avance práctico; para el ecosistema digital, plantea un nuevo estándar en procedimientos y responsabilidad.